Un equipo de investigadores ha logrado ejecutar con éxito un modelo de lenguaje de gran escala en hardware de finales de los años 90, demostrando que la inteligencia artificial moderna no requiere estrictamente tarjetas gráficas de alta gama ni enormes bancos de memoria. Al utilizar un equipo equipado con un procesador Pentium II de 350 MHz y 128 MB de RAM, el equipo demostró que la IA puede funcionar en sistemas que han quedado obsoletos hace décadas.

El experimento, destacado por TechSpot, utilizó un modelo basado en Llama 2 ejecutándose sobre Windows 98. Esta hazaña fue posible gracias al esfuerzo conjunto de Andrej Karpathy y el equipo de EXO Labs, una organización dedicada a ampliar el acceso a la tecnología de inteligencia artificial.

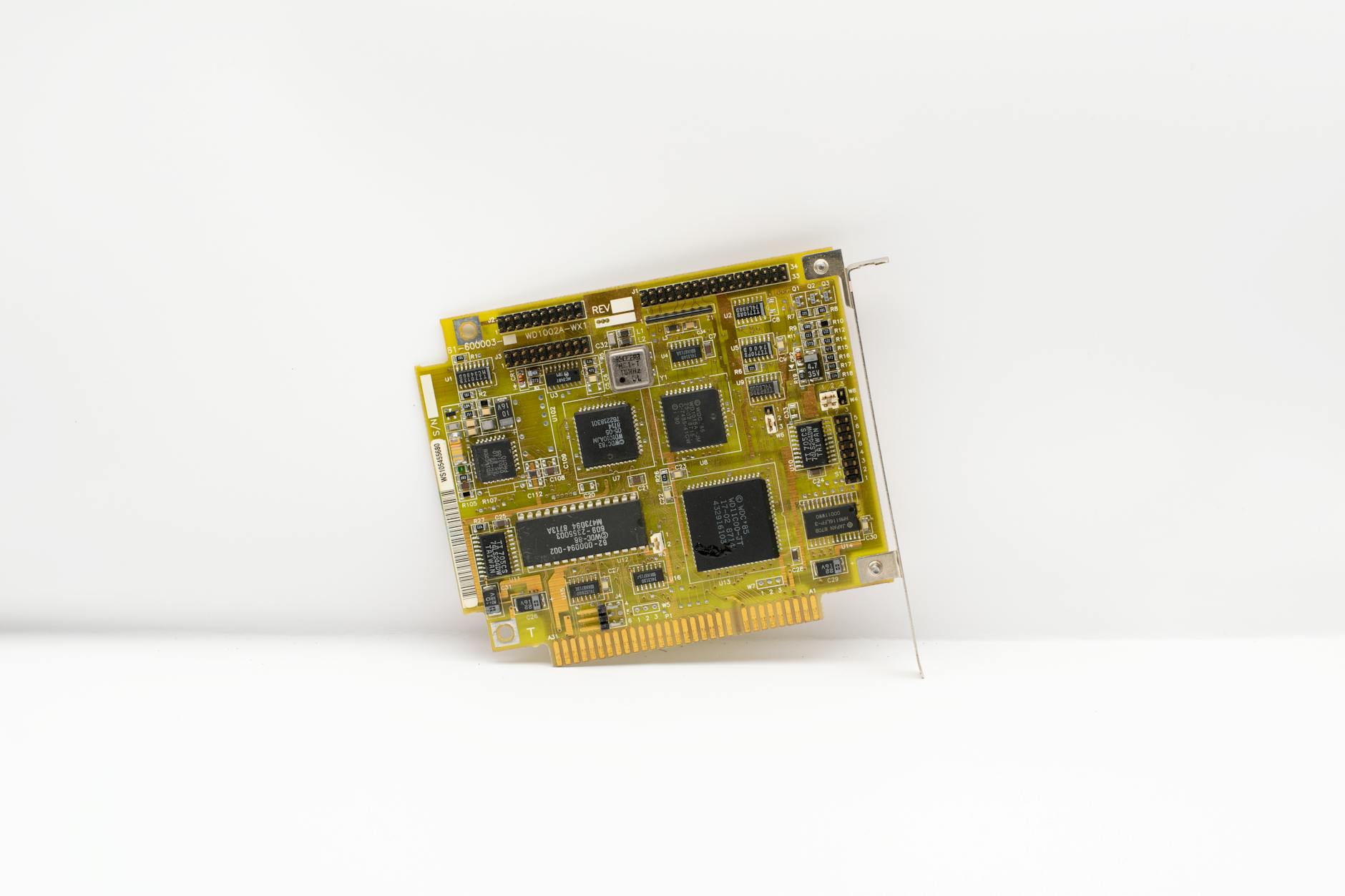

La arquitectura BitNet permite una mayor eficiencia

El avance se centra en BitNet, una arquitectura que utiliza pesos ternarios. Al comprimir modelos de 7 mil millones de parámetros en un tamaño de apenas 1,38 GB, esta arquitectura permite una reducción significativa del modelo sin sacrificar su funcionalidad principal. Este cambio técnico prioriza la potencia de procesamiento de la CPU sobre el hardware especializado que habitualmente se requiere para tareas de aprendizaje automático.

Según EXO Labs, este enfoque optimizado logró velocidades de rendimiento de aproximadamente 39 tokens por segundo. Los desarrolladores señalaron que este método podría mejorar la eficiencia general hasta en un 50 por ciento. Al trasladar la carga de trabajo fuera de infraestructuras costosas y de alto consumo energético, los investigadores buscan democratizar el acceso a las herramientas de IA.

Este desarrollo sugiere un futuro en el que los modelos a gran escala operen de manera fiable en CPUs estándar de consumo a velocidades comparables a la lectura humana. A medida que la tecnología evolucione, podría eliminarse la dependencia actual de hardware de alto rendimiento, permitiendo la integración de la IA en una gama más amplia de dispositivos antiguos y productos de consumo cotidiano.