Las empresas tecnológicas globales están migrando hacia modelos de IA híbrida que procesan los datos directamente en el dispositivo del usuario, en lugar de depender exclusivamente de la nube. Compañías como Intel, Microsoft, Lenovo y HP están lanzando hardware diseñado para ejecutar grandes modelos de lenguaje de manera local, con el objetivo de mejorar tanto la velocidad como la seguridad.

El procesamiento local ofrece una ventaja significativa para la ciberseguridad. Al ejecutar la detección y respuesta directamente en el hardware, los dispositivos pueden identificar amenazas con mayor rapidez que los métodos tradicionales basados en la nube, según Pablo de Pardo, arquitecto de seguridad de software en Intel.

Los requisitos de hardware para la IA local

"Su propia IA local se centra en la telemetría de la CPU, lo que permite detectar amenazas en tiempo real", explicó de Pardo. Señaló que esta tecnología puede identificar malware incluso si ha sido modificado por herramientas de IA generativa, proporcionando una defensa más sólida contra los ciberataques modernos.

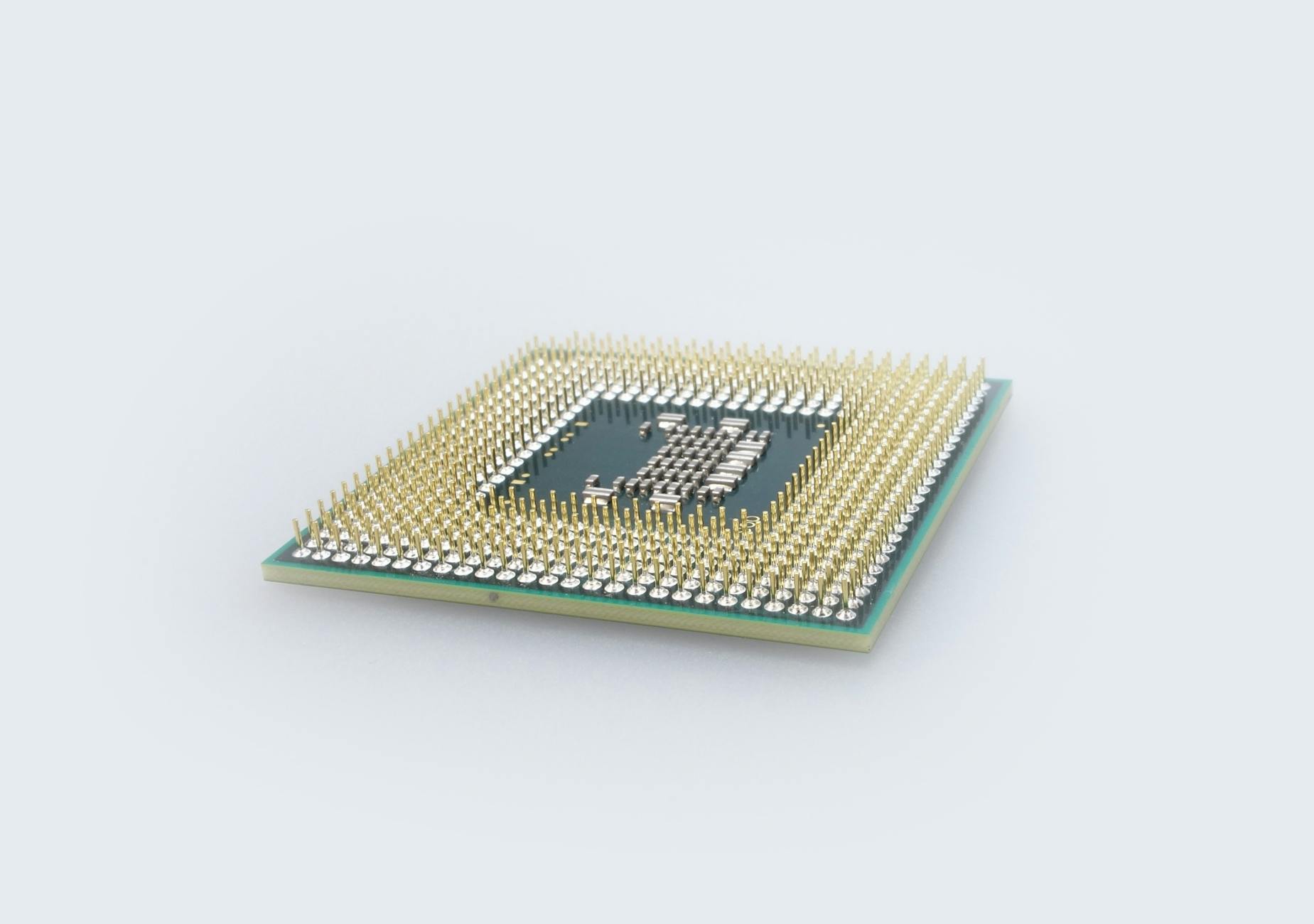

Para soportar estas tareas, los fabricantes están equipando las nuevas máquinas con unidades de procesamiento neuronal, o NPU. Intel, AMD y Qualcomm están integrando estos chips dedicados en sus productos más recientes para potenciar el rendimiento de la IA y, al mismo tiempo, reducir el consumo energético general.

Los requisitos del sistema para estos dispositivos son exigentes. Los expertos sugieren que es necesario un mínimo de 16 GB de RAM para una eficiencia básica, mientras que las cargas de trabajo complejas requieren 32 GB o más. Las unidades de estado sólido (SSD) de alta velocidad también son obligatorias para garantizar que se pueda acceder a los datos sin latencia.

Datos de Deloitte indican que estas herramientas podrían reducir hasta en un 30% el tiempo dedicado a tareas administrativas. Al procesar la información localmente, las empresas también mitigan el riesgo de filtración de datos y mantienen un mejor cumplimiento de las normativas de privacidad.

A pesar de estos beneficios, la transición enfrenta barreras económicas y logísticas importantes. Los chips especializados y la mayor capacidad de memoria elevan el precio de compra inicial de estos equipos, haciéndolos menos accesibles para el consumidor promedio.

Analistas de mercado de TrendForce predicen que el aumento en los precios de la memoria DRAM elevará los costos del hardware en un 15%, lo que complicará aún más su penetración en el mercado. Más allá del costo, la industria se enfrenta al desafío de la fragmentación tecnológica. Dado que no todos los dispositivos poseen la misma potencia de procesamiento, la experiencia del usuario variará significativamente entre los distintos modelos de máquinas.

El mantenimiento también supone un obstáculo. A diferencia de los sistemas basados en la nube que reciben actualizaciones centralizadas, los modelos de IA local requieren actualizaciones individuales para cada dispositivo. Este enfoque descentralizado crea un entorno de gestión complejo tanto para los departamentos de TI como para los usuarios particulares.